El gasto de capital en infraestructura de inteligencia artificial de Tesla fue de 1.000 millones de dólares en el primer trimestre, dijo la compañía en su último informe de resultados.

En una llamada durante la cual la compañía de vehículos eléctricos informó una caída de sus ganancias y un flujo de caja negativo, Tesla señaló su inversión en IA como una oportunidad para el crecimiento futuro.

"Durante los últimos meses, hemos estado trabajando activamente en la expansión de la infraestructura central de inteligencia artificial de Tesla", dijo el director ejecutivo, Elon Musk.

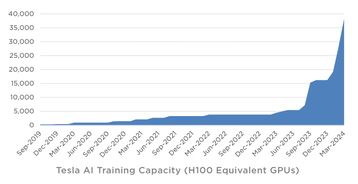

"Durante un tiempo, estuvimos limitados por el entrenamiento en nuestro progreso. En este punto, ya no estamos limitados por el entrenamiento, por lo que estamos progresando rápidamente. Lo hemos instalado y puesto en funcionamiento, lo que significa que realmente están trabajando. 35.000 computadoras H100 o GPU... aproximadamente 35.000 H100 están activas, y esperamos que sean probablemente 85.000 o algo así para finales de este año sólo para capacitación".

En una presentación paralela a la llamada, el cómputo se denomina "GPU equivalente a H100", por lo que también puede incluir otras GPU. No está claro si el número también tiene en cuenta el chip D1 de Tesla, que no es una GPU.

La misma presentación decía que Tesla había aumentado el cómputo de entrenamiento de IA en más de un 130 por ciento en el primer trimestre.

Musk también sugirió que, en algún momento indefinido en el futuro, los autos Tesla podrían funcionar como sistemas Edge cuando no estén en movimiento. "Es algo así como AWS, pero con inferencia distribuida", dijo. "Se necesitan muchas computadoras para entrenar un modelo de IA, pero muchos órdenes de magnitud menos para ejecutarlo.

"Si puedes imaginar el futuro, tal vez en el que haya una flota de 100 millones de Teslas y, en promedio, tengan tal vez un kilovatio de computación de inferencia. Eso son 100 gigavatios de computación de inferencia distribuidos por todo el mundo. Es bastante difícil reunir 100 gigavatios de computación de IA e incluso en un futuro autónomo donde el automóvil, tal vez, se use en lugar de 10 horas a la semana, se usará 50 horas a la semana.

"Eso todavía deja más de 100 horas a la semana en las que el ordenador de inferencia del coche podría estar haciendo otra cosa. Y parece que sería un desperdicio no utilizarlo".

No está claro qué tan concreta es la idea: Musk afirmó en 2022 que la supercomputadora Dojo de la compañía (que usa su chip D1 y GPU) probablemente estaría disponible para otras empresas "al estilo de los servicios web de Amazon". También ha prometido en repetidas ocasiones productos que aún no se han lanzado.

A principios de este mes, la compañía anunció que planeaba despedir al 10 por ciento de su fuerza laboral global, o alrededor de 14.000 personas.