Novas pesquisas sugerem que a IA usada em data centers pode usar tanta eletricidade quanto um pequeno país como a Holanda e a Suécia até 2027.

O consumo anual de eletricidade relacionado à IA em todo o mundo poderá aumentar entre 85,4 e 134 TWh antes de 2027, de acordo com uma pesquisa revisada por pares produzida pelo pesquisador Alex de Vries, publicada pela Digiconomist na revista Joule. Isso representa aproximadamente 0,5% do consumo mundial de eletricidade e um crescimento substancial no uso de eletricidade em data centers, que atualmente é estimado entre 1% e 2% do uso mundial de eletricidade.

O resultado repercute uma estimativa feita por Jon Summers e Tor Bjorn Minde, do instituto de pesquisa sueco RISE, no DCD>Connect London semana passada, de que a IA poderia consumir tanta eletricidade quanto a Suécia.

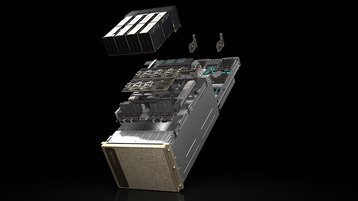

1,5 milhão de chips Nvidia DGX

“Nos últimos anos, o consumo de eletricidade dos data centers representou um percentual relativamente estável de 1% do uso global de eletricidade, excluindo a mineração de criptomoedas”, afirma de Vries no artigo The Growing Energy Footprint of Artificial Intelligence. “Entre 2010 e 2018, o consumo global de eletricidade dos data centers provavelmente aumentou apenas 6%. Há uma preocupação crescente de que os recursos computacionais necessários para desenvolver e manter modelos e aplicativos de IA possam causar um aumento na contribuição dos data centers ao consumo global de eletricidade”.

De Vries, que realiza seu Ph.D. na Vrije Universiteit Amsterdam, calculou os números do artigo observando a produção anual dos chips Nvidia DGX, que são usados em 95% dos grandes aplicativos de IA. Embora atualmente existam gargalos no fornecimento desses chips, de Vries acredita que serão resolvidos em breve, desencadeando uma enxurrada que poderá efetivamente adicionar 50% ao consumo mundial de energia dos data centers.

“A IA pode ser responsável por tanto consumo de eletricidade quanto o Bitcoin é hoje em apenas alguns anos”, diz de Vries, que fundou a Digiconomist há nove anos para examinar “as consequências não intencionais das tendências digitais”, concentrando-se no uso de energia do Bitcoin.

De Vries discutiu o uso de energia do Bitcoin em um Podcast da DCD em 2022, e o Digiconomist estima que atualmente o Bitcoin consuma 126 TWh de eletricidade por ano, o que equivale aproximadamente ao consumo dos Emirados Árabes Unidos.

O artigo parte do consumo de energia de um único servidor Nvidia DGX A100, que pode consumir de 3 kW a 6,5 kW (o mesmo que várias casas dos EUA juntas), enquanto a versão H100 do chip pode consumir mais de 10 kW em um servidor inteiro com vários chips.

A Nvidia produzirá por volta de 100 mil desses chips em 2023, mas poderá lançar 1,5 milhão por ano até 2027, diz De Vries, graças a um acordo com a fabricante de chips TSMC. O consumo de eletricidade de um ano de produção destes sistemas consumiria aproximadamente 85 a 134TWh de eletricidade, ele diz.

O valor é aproximado – nem todas essas unidades serão utilizadas em plena capacidade. No entanto, não inclui a base instalada que estará operacional nesse momento e outro uso de energia associado a esses chips, incluindo sistemas de refrigeração, transporte, fabricação e outras emissões de Escopo 3.

“Ainda que a cadeia de fornecimento de servidores de IA lide com alguns gargalos que irão atrasar o consumo de eletricidade relacionado à IA em um futuro imediato, não deve levar muito tempo para que sejam resolvidos”, afirma de Vries.

“Até 2027, o consumo mundial de eletricidade relacionado à IA poderá aumentar de 85,4 a 134 TWh de consumo anual de eletricidade de servidores recém-fabricados. Este valor é comparável ao consumo anual de eletricidade de países como Holanda, Argentina e Suécia”.

Embora a maior parte da atenção se concentre na energia utilizada no treinamento de sistemas de IA, de Vries alerta que a fase de aplicação ou “inferência” de seu uso também pode consumir muita energia. Em sua participação no DCD>Connect na semana passada, Jon Summers e Tor Bjorn Minde da RI.SE fizeram uma observação semelhante, em uma fala que examinou como o resfriamento do ar é incapaz de fornecer a remoção de calor necessária para um consumo de energia tão denso.

Summers e Minde observaram que, em um aplicativo como o Google Search, uma IA pode ser utilizada com tanta frequência que a energia utilizada na fase de inferência de baixo consumo de energia se multiplica até ser tão grande como a utilizada no treino.

De Vries observa que a aplicação da IA ao Google Search pode, na pior das hipóteses, aumentar o seu consumo de energia ao valor do utilizado na Irlanda, por volta de 29 TWh por ano, mas observa que o simples custo de fazer isto pode desencorajar o Google a implementá-lo.

Ele pede que a indústria fique “atenta ao uso da IA”, fazendo o seguinte aviso: “Tecnologias emergentes como a IA e antes a blockchain chegam com muito entusiasmo e medo de perdas. Isso muitas vezes leva à criação de aplicativos que trazem pouco ou nenhum benefício aos usuários finais.

“No entanto, sendo a IA uma tecnologia que utiliza muita energia, isto também pode causar uma quantidade significativa de desperdício de recursos. Grande parte desse desperdício pode ser mitigada dando um passo atrás e tentando construir soluções que proporcionem melhor adaptação às necessidades dos usuários finais (e evitar forçar o uso de uma tecnologia específica)”.

Ele conclui: “A IA não será uma cura milagrosa para tudo, pois, em última análise, tem várias limitações. Estas limitações incluem fatores como alucinações, efeitos discriminatórios e preocupações com a privacidade. A sustentabilidade ambiental agora é mais um acréscimo a essa lista de preocupações”.

O artigo está disponível gratuitamente por 50 dias, ou pedindo diretamente ao autor.